Телеграм канал «Русский маркетинг»

Реклама и обратная связь: @mLccrew

https://knd.gov.ru/license?id=672dfdbae9b24e448c4a6b9d®istryType=bloggersPermission

телеграм-каналов

рекламных размещений, по приросту подписчиков,

ER, количеству просмотров на пост и другим метрикам

и креативы

а какие хуже, даже если их давно удалили

на канале, а какая зайдет на ура

Самое главное — нигде не потерять эту палочку, а то деньги магическим образом окажутся у того, кто её найдёт.

В своём поп-апе бренд продаёт самые обычные вещи втридорога, просто придумывая для них премиальные названия. Так, обычный лимон превратился в «капсулу лимонной кислоты с фотонным усилением» за 19 тыс. рублей, а рулон туалетной бумаги — в «цилиндр для очищения с высокой удерживающей способностью» за 10 тыс. рублей.

Свои поп-апы The Ordinary открыла в Торонто, Лондоне, Сан-Паулу и Мельбурне.

Минцифры получило от Roblox гарантии соблюдения законов Российской Федерации. И подтвердила свои обязательства бороться с появлением и распространением на платформе контента, причиняющего вред здоровью и развитию детей.

Получается, что бренд не пытается удивить невероятными преимуществами, не рассказывает сложные продуктовые истории и не обещает изменить жизнь покупателя. Вместо этого он как бы встраивает себя в категорию вещей, которые не требуют доказательств.

Что было сделано в рамках самой кампании:

— Наружная реклама получила десятки адаптаций под конкретные локации Москвы и Петербурга;

— В digital сохранилась единая механика;

— Появился Telegram-спецпроект с поиском кроссовок;

— Блогеры подхватили формат и превратили его во флешмоб.

По сути, кампания решает вполне понятную бизнес-задачу — напоминает аудитории, что на Lamoda представлен широкий ассортимент adidas Originals: от культовых моделей кроссовок до одежды и аксессуаров различных франшиз бренда. И да, это хороший пример того, как из, казалось бы, утилитарного сообщения «бренд есть в наличии» можно построить полноценную креативную платформу.

И, надо сказать, задумка им абсолютно удалась. Глядя на эти фотографии, невольно хочется пуститься в роуд-трип, чтобы наблюдать такие пейзажи за окном.

Этим местом оказался остров Готланд, где IKEA установила два гигантских гранитных кресла, созданных по мотивам садового стула SKARPÖ. Теперь любой желающий может приехать на остров, сесть в кресло и наслаждаться солнцем.

Кстати, чтобы найти этот квадратный метр, IKEA потратила два года на исследования, анализ архивных погодных данных и детальное изучение географии страны.

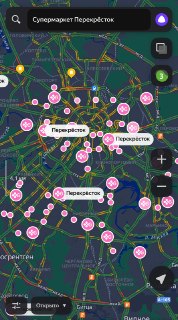

На днях пользователи Threads* заметили, что все московские «Перекрёстки» на Яндекс Картах вдруг стали розовыми. Скриншоты быстро полетели по соцсетям, хотя многие сначала подумали, что это какой-то сбой в работе сервиса.

Оказалось, что таким образом сеть «Перекрёсток» и Eggsellent анонсировали запуск совместную линейку завтраков. Мне это откликается тем, что карты обычно воспринимаются как сервис, а не как рекламная площадка (хотя в последнее время рекламных баннеров там много, да). Поэтому любое изменение там выглядит как событие, а не как очередной рекламный баннер.

В итоге что мы получаем: люди сами начали обсуждать запуск ещё до официального анонса, причем в соцсети, которая формально и не заблокирована и не запрещена. И да, обратите внимание, что именно Threads все чаще становится предметом внимания маркетологов брендов, потому что именно она способна давать бесплатные охваты и хороший рост статистики.

*Принадлежит Meta, которая признана экстремистской и заблокирована в России