Телеграм канал «PixelMap»

Сайт: https://pixel-map.ru/mentoring

По вопросам: /@ohkostya

телеграм-каналов

рекламных размещений, по приросту подписчиков,

ER, количеству просмотров на пост и другим метрикам

и креативы

а какие хуже, даже если их давно удалили

на канале, а какая зайдет на ура

Креативный:)

На первый взгляд — просто новая строчка в аналитике. На деле — важный сигнал для digital-рынка.

Что это значит для бизнеса

AI начинает забирать роль поиска.

Раньше пользователь:

👉 гуглил → открывал сайты → сравнивал → покупал

Теперь все чаще:

👉 спрашивает нейросеть → получает готовую выжимку → переходит только в финальную точку

А иногда не переходит вообще.

Что это ломает:

▪️ классическое SEO

▪️ воронки

▪️ рекламные сценарии

▪️ привычную веб-аналитику

▪️ контент-маркетинг

Компании буквально теряют контроль над тем, как пользователь впервые знакомится с их продуктом.

Теперь первое касание может происходить не на лендинге, а внутри ответа нейросети. Если AI советует ваш продукт, но пользователь получает ответ сразу в чате и не переходит на ваш сайт — это станет заметно по падению конверсий. Зато теперь есть прямой фидбэк: какой контент и какие страницы сайта чаще всего цитируются AI-помощниками, чтобы пользователи переходили к вам.

Что это значит для дизайнеров

UX перестает ограничиваться интерфейсом сайта.

Теперь нужно думать:

➡️ как AI интерпретирует продукт

➡️ какие данные нейросеть видит

➡️ насколько понятно описаны функции

➡️ может ли LLM корректно пересказать ваш сервис

То есть появляется новый слой работы: дизайн для AI-посредников.

Простой пример:

если ваш продукт сложно объяснить нейросети — пользователь может вообще не понять его ценность

Получается, раньше дизайнер боролся за внимание человека, теперь — еще и за внимание ИИ.

Что станет важнее:

✔️ структурированный контент

✔️ дизайн-системы

✔️ консистентность интерфейсов

✔️ понятные сущности и сценарии

✔️ AI-readable UX

Что начнет умирать:

❌ SEO-страницы ради ключей

❌ «маркетинговая вода»

❌ перегруженные лендинги

❌ сложные user-flow ради удержания

ИИ банально выжимает из продукта суть. И если этой сути нет — никакой красивый интерфейс уже не спасет.

Иду на курс Александра Горного, обещает за следующую неделю научить всему самому главному. Посмотрим.

https://claude.aiacademy.me/

1 RockITSoft — 5 286 млн ₽ (-10,9%)

2 Notamedia — 3 426 млн ₽ (+14,5%)

3 BSS — 3 199 млн ₽ (-0,7%)

4 Centicore — 3 009 млн ₽ (+77,4%)

5 ITFB Group — 2 593 млн ₽ (+43,6%)

6 Dalee — 2 049 млн ₽ (+52,5%)

7 Agima — 1 753 млн ₽ (-0,0%)

8 Globus — 1 280 млн ₽ (-20,4%)

9 Extyl — 1 248 млн ₽ (+78,7%)

10 Umbrella IT — 1 243 млн ₽ (+30,2%)

11 Nordclan — 937 млн ₽ (-2,7%)

12 AWG — 884 млн ₽ (+57,3%)

13 Graphene — 848 млн ₽ (+77,6%)

14 Simpl — 838 млн ₽ (+16,1%)

15 QSOFT — 689 млн ₽ (+29,3%)

16 TAGES — 681 млн ₽ (+6,6%)

17 KTS — 658 млн ₽ (+26,5%)

18 Terabit — 651 млн ₽ (+27,7%)

19 Garpix — 629 млн ₽ (-0,7%)

20 Zebrains — 590 млн ₽ (+23,0%)

21 Proscom — 525 млн ₽ (+132,0%)

22 Аспро — 507 млн ₽ (+27,7%)

23 Факт — 475 млн ₽ (+18,8%)

24 KT.Теам — 469 млн ₽ (+33,6%)

25 Вебпрактик — 469 млн ₽ (+40,0%)

26 Aero — 441 млн ₽ (-35,0%)

27 Morizo — 392 млн ₽ (+0,1%)

28 ITECH group — 385 млн ₽ (+14,4%)

29 ADV — 383 млн ₽ (+0,7%)

30 Greensight — 360 млн ₽ (-13,6%)

31 Div. — 347 млн ₽ (+23,9%)

32 Chat2Desk — 319 млн ₽ (+21,3%)

33 Dex — 283 млн ₽ (-27,5%)

34 ARTW — 279 млн ₽ (+5,2%)

35 StecPoint — 272 млн ₽ (-48,4%)

36 RDN Group — 260 млн ₽ (+0,8%)

37 Articul — 242 млн ₽ (+3,8%)

38 Progressive Media — 231 млн ₽ (+7,3%)

39 Jetstyle — 228 млн ₽ (+4,6%)

40 Kotelov — 226 млн ₽ (-28,3%)

41 Escape Tech — 222 млн ₽ (+8,9%)

42 DD Planet — 198 млн ₽ (-50,0%)

43 Reactive — 188 млн ₽ (-29,2%)

44 Quantum Art — 182 млн ₽ (-47,2%)

45 SoftMediaLab — 169 млн ₽ (-40,7%)

46 Atwinta — 167 млн ₽ (+2,3%)

47 Doubletapp — 162 млн ₽ (+46,6%)

48 BSL — 143 млн ₽ (-65,1%)

49 Космос-Веб — 134 млн ₽ (-8,8%)

50 fuse8 — 131 млн ₽ (+31,0%)

Целиком со всем рейтингом можно ознакомиться на сайте.

Общая динамика рынка аутсорс разработки по нашей версии: +8,8%

Обратите внимание на рекламные возможности нашего проекта.

По вопросам сотрудничества пишите @Gen_dir

@digirate_ru

#Digirate #аутсорс2025 #рейтинг

OpenAI выпустили официальный аддон для Excel и Google Sheets, который умеет:

— собирать таблицы с нуля по текстовому запросу

— писать и чинить формулы

— анализировать большие файлы и связи между листами

— чистить данные

— объяснять, почему «сломался» ваш Excel-франкенштейн

— обновлять модели и отчеты прямо внутри документа

Особенно мощно выглядит для аналитиков, продактов, маркетологов, которые ведут данные руками и постоянно тонут в табличной рутине.

Что важно:ChatGPT работает прямо в сайдбаре Excel/Sheets и вносит изменения в документ после подтверждения пользователя. То есть это не очередной «скопируй CSV в чат», а нативная интеграция.

OpenAI отдельно подчеркивают, что система умеет работать с большими многостраничными файлами, понимать зависимости между формулами и объяснять свои действия. Пока это бета-версия, но направление уже очевидно: интерфейс таблиц превращается в разговорный.

🔗 Официальный аддон

Инструмент доступен всем — бесплатно.

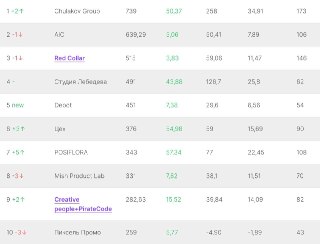

1. Chulakov Group — 739 млн ₽ (+50,4%)

2. AIC — 639,3 млн ₽ (+5,1%)

3. Red Collar — 515 млн ₽ (+3,8%)

4. Студия Лебедева — 491 млн ₽ (+43,9%)

5. Depot — 451 млн ₽ (+7,4%)

6. Цех — 376 млн ₽ (+55,0%)

7. POSIFLORA — 343 млн ₽ (+57,3%)

8. Mish Product Lab — 331 млн ₽ (+7,8%)

9. Creative people+PirateCode — 282,6 млн ₽ (+15,5%)

10. Пиксель Промо — 259 млн ₽ (+5,8%)

11. ONY — 257 млн ₽ (+6,7%)

12. Uplab — 255,4 млн ₽ (+5,1%)

13. Beta — 209 млн ₽ (+6,5%)

14. Only — 175 млн ₽ (+18,1%)

15. Pragmatica — 163 млн ₽ (+108,8%)

16. Pinkman — 161 млн ₽ (-42,1%)

17. Usabilitylab — 135 млн ₽ (-22,9%)

18. Nimax — 120,6 млн ₽ (-26,3%)

19. Redis — 76 млн ₽ (-29,0%)

20. Сloudmill — 69 млн ₽ (+64,3%)

Целиком со всем рейтингом можно ознакомиться на сайте.

Общая динамика рынка мобильной разработки по нашей версии: +13,4%

Обратите внимание на рекламные возможности нашего проекта.

По вопросам сотрудничества пишите @Gen_dir

@digirate_ru

#Digirate #дизайн2025 #рейтинг

Я уже рассуждал про концепцию агентского опыта? Так вот, я твердо убежден: эпоха привычных кнопок и бесконечных меню стремительно уходит в закат. И вот почему.

Конец эпохи жестких рамок

Традиционная разработка — это всегда строгие правила. Под каждую функцию нужна отдельная кнопка, под каждый ввод — свое прямоугольное поле. Мы буквально втискиваем живые человеческие потребности в жесткие сценарии, которые нарисовали дизайнеры. Итог? Нагромождение графики, путаница и «оу щит, как этим пользоваться?» со всеми этими онбордингами и туториалами.

Тяжелая ноша техподдержки

Помимо того, что это неудобно пользователю, такие системы — это ад для тех, кто их пилит. Каждое выпадающее меню или новое окно — это колоссальные усилия разработчиков и тяжелая инфраструктурная задача. Вместо того чтобы качать саму суть продукта, мы тратим время на перекладывание графических элементов. Дорого, долго и неповоротливо.

Иллюзия универсальности

Жесткая заданность классики делает софт абсолютно негибким.

Зацените кейс из жизни: раньше для поездки нужно было открыть приложение с билетами, потом карты, потом сервис бронирования, а в конце — банковский клиент для оплаты.

Жесть. Человек лишен возможности просто наговорить задачу голосом или написать обычным языком в одно-единственное окно и сразу получить результат. Технологии уже давно должны сами подстраиваться под нас, а не заставлять заново учить правила каждой программы.

Вся сила в едином пространстве

Именно поэтому на сцену выходят современные диалоговые помощники нового поколения. Они ломают преграды. Теперь в одном окне я могу:

— узнать остаток на счете;

— уточнить прогноз погоды;

— составить план на день;

— рассчитать смету на год.

Никаких переключений и поиска кнопок. Система сама решает, какие механизмы задействовать, чтобы выполнить мой запрос. Это и есть настоящий агентский опыт.

Где границы, Лебовски?

Будет нечестно сказать, что кнопки исчезнут везде. Там, где важна пространственная точность — монтаж видео, архитектура, сложные графики — визуал останется. Но диалоговый опыт заберет на себя всю рутину и организацию процессов, оставив старому подходу роль узкого профессионального инструмента.

Подводя итог: мы стоим на пороге фундаментального сдвига. Переход от «тыканья в кнопки» к прямому смысловому диалогу — это закономерная эволюция. Мы наконец-то перестанем быть придатками к машинам и начнем общаться с ними на равных, экономя самое ценное — наше время и внимание.

Как вам такой расклад? Будем скучать по кнопкам или ну их?