Телеграм канал «AI для Всех»

Главный редактор и по рекламе: @crimeacs

Иногда пишут в канал: @GingerSpacetail, @innovationitsme

телеграм-каналов

рекламных размещений, по приросту подписчиков,

ER, количеству просмотров на пост и другим метрикам

и креативы

а какие хуже, даже если их давно удалили

на канале, а какая зайдет на ура

В Нью-Йорке проходит абсолютно безумная Tech Week, в рамках которой Hyperagents (версия клешни с человеческим UI от Airtable) устроили хакатон. Кто за час навайбкодит самый убедительный outreach. В качестве цели каждому был выбран рандомный другой фаундер в комнате. Моя идея победила!

Я взял наш с Антоном https://funnel.fyi и прогнал через нее сайт, Funnel мгновенно нашел что можно поправить на лендинге, а Hyperagents собрали симпатично выглядящий видос и презентацию.

К чести Hyperagents - пока я расспрашивал этого фаундера что у него болит, он честно и автономно трудился.

И вуаля - я победил 🥇

Может и вам полезно будет - попробуйте!

UPD: добавил презентацию

Заставил AI бесконечно улучшать свою работу - и запретил ему верить самому себе на слово.

Так появился новый скилл для Claude - auto-improve.

Auto-improve позволяет улучшить любой артифакт, который совместим с git:

• AI предлагает маленькое улучшение.

• Другой AI проверяет результат по понятным критериям.

• Если стало лучше - изменение сохраняется.

• Если нет - автоматически откатывается.

Благодаря git каждая версия сохранена, каждую можно сравнить, каждую можно вернуть. И так по кругу, пока результат перестает улучшаться.

Auto-improve можно применять почти ко всему:

• тексты

• письма

• лендинги

• README

• инструкции

• промпты

• код

• договоры

Вообще ко всему, где можно описать, что значит «хорошо».

Самое интересное: критерии тоже можно улучшать.

Например, можно взять книгу, статью, гайделайн или внутренний стандарт компании.

Превратить это в список требований.

И дальше AI будет улучшать работу уже не «на вкус», а по этим требованиям.

Технически это похоже на GAN для текста: один агент генерирует, другой проверяет. Или на маленький локальный RLAIF-loop: улучшение → оценка → принятие или откат.

Код:

https://github.com/crimeacs/auto-improve

Послушать можно тут

Вчера, Anthropic выпустил режим, в котором Claude сам разбивает большую задачу на подзадачи, запускает parallel subagents, проверяет результаты и собирает финальный ответ. В announcement они приводят примеры вроде bug hunt по всей кодовой базе, большие миграции и тп.

Мое первое ощущение: /Workflows одна из первых «agent swarm» фичей, которая выглядит как реальный рабочий инструмент.

Ты даешь задачу - Claude уходит на 30–50 минут, пишет код, правит ошибки, проверяет себя и продолжает.

На мой взгляд, самая вишенка не в том что много параллельных агентов жрут токены, а в цикле generator → validator. Одна часть системы делает изменения: код, refactor, tests. Другая пытается это проверить: смотрит diff, ищет ошибки, думает про edge cases.

Это немного похоже на GAN, только для engineering workflow. Сгенерировал → проверил → нашел проблему → исправил.

Тесты пока не всегда понятно насколько хорошие, но свои ошибки оно уже реально ловит.

Чего мне не хватает - прозрачного этапа планирования. Сейчас ощущение такое: «вот задача, иди делай».

А идеальный flow был бы:

1) сначала Claude предлагает план;

2) ты его правишь;

3) добавляешь constraints, success criteria, важные файлы и проверки;

4) и только потом запускаешь workflow.

Мой вывод: направление очень сильное!

Блог-пост

Поделитесь с коллегами, если тоже следите за тем, как coding agents становятся рабочим процессом.

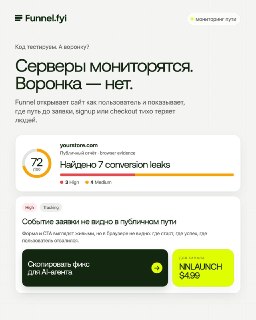

После релиза всё может выглядеть нормально: сайт открывается, серверы живы, логи чистые. Но заявки почему-то не приходят.

Причина может быть не в продукте, а в мелком недочете по пути:

- форма молча падает,

- checkout/signup застрял,

- CTA ведёт не туда,

- оффер непонятен,

- и тп

Вы можете продолжать лить трафик и думать, что “продукт не зашёл”, хотя на самом деле сломался один шаг в воронке.

Для решения этой проблемы мы с другом сделали Funnel.fyi: кидаешь URL - агент проходит сайт как пользователь, находит где теряются люди, показывает evidence и пишет fix prompt для Cursor / Claude / Codex.

Попробуйте 👇:

https://www.funnel.fyi

В комменты кидайте, что сканировали и где агент был прав / тупил - это поможет нам докрутить продукт.

Как у них выстроена система хранения данных и контекста?

Как управляются сессии?

Какие фичи они делают для своих харенсов?

Какие процессы автоматизируют?

Как строят скилы и агентов?

Как структурируют семантическую и процедурную память?

В следующий понедельник проведу виртуальный воркшоп, где 4 фаундера (я буду только модерировать) покажут свои сетапы и воркфлоу.

Правила: запрещены слайды и теория, только шаринг экрана и живые демо по 15 минут + ответы на вопросы.

Регистрация тут, не нужно подписываться на каналы, бесплатно, никакой рекламы. Но на Английском.