Телеграм канал «Web3 на доступном»

Комьюнити: @easynft_chat

Регистрация на курс по дропам: @easyweb3_reality

Реклама и партнёрства: @dasha_matushinets

телеграм-каналов

рекламных размещений, по приросту подписчиков,

ER, количеству просмотров на пост и другим метрикам

и креативы

а какие хуже, даже если их давно удалили

на канале, а какая зайдет на ура

MetaMask запустил Agent Wallet — некастодиальный кошелёк, где сделки совершает не человек, а AI-агент.

Подключаешь Claude Code, OpenAI Codex или Cursor и бот торгует сам.

Самое сочное: среди поддерживаемых площадок — Hyperliquid. То есть формально можно посадить нейросеть лудить на перпах, пока вы спите.

Как это работает:

🟠Guard Mode — вы заранее задаёте лимиты трат и список разрешённых протоколов. Подозрительная сделка требует 2FA.

🟠Beast Mode — агент торгует свободнее, но с «неотключаемыми» страховками: лимиты и сканирование адресов остаются.

Звучит надёжно. Но вот цитата директора по продукту MetaMask Чжэнь Ю Йонга:

«Нельзя гарантировать, что LLM не обманут. Prompt injection — это открытая исследовательская проблема, а не баг, который чинится один раз».

Простыми словами: агент может слить депозит не потому что плохо торгует, а потому что его заскамил чужой промпт на сайте.

Доверите своему AI-агенту лудить на фьючах?

🔥 — го, пусть пашет за меня

🤡 — отдать ключи боту, гениально

👎 — сам солью, без посредников

@NFT_Reality

Zcash — это приватная криптовалюта, которая скрывает суммы и участников переводов. Почти четыре года в ней пряталась серьёзная ошибка, и её не нашли ни хакеры, ни платные аудиторы. Нашёл искусственный интеллект — модель Claude Opus 4.8.

🔐 В чём была проблема: ошибка скрывалась всего в двух строчках кода, одна из проверок просто не работала. Из-за этого теоретически можно было создавать поддельные монеты Zcash «из воздуха», а сеть бы этого не заметила.

Исследователь Тейлор Хорнби из компании Shielded Labs показал код нейросети, она указала на уязвимость, а он собрал рабочий пример атаки, чтобы убедиться, что угроза реальна.

После новости цена Zcash за сутки упала более чем на 50%, но затем отыграла 41,5% — разработчики успели закрыть дыру обновлением сети 👑

Как вам новая роль AI в безопасности?

👍 — хорошо, дыры будут находить раньше

🤡 — этим же инструментом воспользуются и взломщики

🌚 — приватным монетам теперь меньше доверия

@NFT_Reality

Pump fun, площадка, где любой за минуту выпускает мем-монету, открыл сервис GO. Это маркетплейс заданий за крипту.

🌱 Как это устроено

Заказчик придумывает задание, кидает награду от $5 на заморозку. Исполнитель делает, грузит пруф, забирает деньги. Нужны привязка X и кошелёк, спорные задания режет модерация Pump fun, её решения финальные.

🤨 Во что это превратится

Слоган у сервиса честный — «заплати кому угодно за что угодно». Дальше фантазия дорисовывает сама: побриться налысо на камеру, набить тату с тикером, сто тысяч раз повторить название очередного скама. Внимание давно стало валютой, теперь у него появился прайс-лист: от $5.

Выполнили бы задание за деньги?

❤️ — возьмусь, если ценник нормальный

🌚 — только за что-то безобидное

🤡 — сам бы заказал

@NFT_Reality

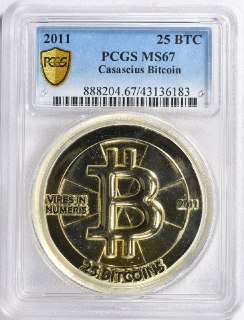

3 июня кто-то впервые с 2011 года сорвал голограмму со старой металлической монеты $BTC и активировал кошелёк на 25 $BTC. На момент чеканки они стоили меньше $100. Сейчас — около $1.78 млн.

🪙 Что это вообще за монета

В 2011 году американец Майк Колдуэлл начал чеканить настоящие металлические монеты Casascius — на вид обычные сувенирные монетки. Но фишка внутри: под голограммной наклейкой спрятан приватный ключ от реального биткоин-кошелька, куда заранее положены настоящие $BTC.

То есть монета — это физический «носитель» крипты. Пока голограмму не сорвал, биткоины лежат на блокчейне нетронутыми: любой может проверить, что они там есть, но потратить не может. Сорвал наклейку → получил ключ → выводи крипту.

Сейчас такие уже не делают — Колдуэлл свернул чеканку в 2013-м после наезда регуляторов. Так что уцелевшие монеты это редкость + живая крипта стоимостью миллион баксов внутри.

🤡 В чём прикол ситуации

Человек 15 лет держал дома монету, которая молча превратилась из «меньше сотки баксов» в почти два миллиона. Не торговал, не следил за графиком, не паниковал в обвалы — просто не трогал.

Классика крипты: самые богатые холдеры — это те, кто потерял пароль или забыл, что у них вообще что-то есть.

Что это было?

🔥 — даймонд хендс уровня бог

🤡 — просто забыл и повезло

🌚 — я бы вскрыл ещё на профите в +20%

@NFT_Reality

Регулятор, который пару лет назад судился с половиной крипто-индустрии, опубликовал пятилетний план с фокусом на цифровые активы.

Председатель Пол Аткинс прописал, что блокчейн «может революционизировать финансовую инфраструктуру Америки».

Что обещают к 2030:

🟢рамки для токенизации акций и облигаций

🟢правила для кастоди, торговли и стейкинга без двойных требований

🟢разграничение полномочий с CFTC

При Генслере та же контора кошмарила Coinbase, Kraken и Binance через суды. Сейчас планируют, как им же легально работать.

Для рынка это значит, что ETF, токенизированные акции и стейкинг в США перестают быть серой зоной. В ближайшие годы туда придут институционалы — со всеми плюсами для цены.

Верим в SEC-разворот?

👍 — да, наконец по-взрослому

👎 — SEC не изменит принципов, регуляция к худшему

🤡 — нам-то с этого что

@NFT_Reality

В обзоре финстабильности ЦБ показал, сколько россияне вложили в крипто-инструменты на российском рынке

Итого ₽3,8 млрд:

🟢фьючерсы на BTC и ETH на Мосбирже — 5600 трейдеров, ₽1,7 млрд

🟢крипто-ЦФА — ~3800 человек, ₽354 млн

🟢копитрейдинг с крипто-стратегиями — 271 инвестор, ₽85,6 млн

🟢структурные облигации на iShares BTC/ETH ETF — ₽4,1 млрд

ЦБ резюмирует: «объём вложений россиян в криптоактивы на российском рынке не создаёт рисков для финансовой стабильности».

По-человечески — «вы у нас все на учёте, но пока маленькие, поэтому можно».

Как вам такая «легальная крипта»?

🔥 — лучше так, чем никак

🤡 — мне всё равно, я в DEX

@NFT_Reality

Дуров только что объявил: нативная валюта TON становится Gram. Без голосования, без обсуждения — просто поставил всех перед фактом.

Аргумент у Дурова красивый: Gram — оригинальное название токена из вайтпейпера 2018-го, которое Telegram не смог запустить из-за иска SEC.

Что по факту:

🪙 Gram — новое имя валюты, TON остаётся названием блокчейна

⏳ переход займёт около 3 недель

🎯 это шаг 4 из 7 в плане Make TON Great Again

И главный вопрос: а надо было спрашивать?

❤️ — нет, Дуров знает лучше, доверяю

👎🏻 — да, это же децентрализация, где голосование?

🤡 — комьюнити тут для мебели, всё ясно

@NFT_Reality