Телеграм канал «Linux Education»

Реклама — @cyberJohnny

Заявление в РКН: https://knd.gov.ru/license?id=6784bbba96de59064dc32602®istryType=bloggersPermission

телеграм-каналов

рекламных размещений, по приросту подписчиков,

ER, количеству просмотров на пост и другим метрикам

и креативы

а какие хуже, даже если их давно удалили

на канале, а какая зайдет на ура

Изучите техники (https://codeby.academy/course/kurs-analiz-zashhishhennosti-infrastruktury-na-osnove-tehnologij-active-directory/?erid=2VtzqwPJg3i&utm_source=tg&utm_medium=cpc&utm_campaign=ad_june_26&utm_content=linuxkalii&utm_term=site)и методики атак на инфраструктуру Active Directory!

Наша практическая лаборатория содержит более 30 виртуальных машин, которые вам предстоит сломать. Успейте записаться на курс до 18 июня🚗

➡️ Регистрация (https://codeby.academy/course/kurs-analiz-zashhishhennosti-infrastruktury-na-osnove-tehnologij-active-directory/?erid=2VtzqwPJg3i&utm_source=tg&utm_medium=cpc&utm_campaign=ad_june_26&utm_content=linuxkalii&utm_term=site)

Содержание курса:

⏺️AD-сети с миксом Windows/Linux

⏺️Харденинг в AD, добыча критичной информации, развитие по инфраструктуре

⏺️Захват и укрепление позиций внутри инфраструктуры

⏺️Применение и анализ популярных эксплоитов

Авторы курса: HackerRalf (Михаил Порываев) и BlackRabbit (Павел Никитин), 5-кратные победители the Standoff

😀☺️😚🥲😎Дарим доступ к 20+ заданиям на взлом AD на hackerlab.pro (hackerlab.pro) при записи на курс!

@linux_education

🏠 ТОН-М — ваш надежный поставщик!

Работаем с 2009 года. Прямые поставки от заводов = низкие цены.

Для бизнеса:

— Отсрочка платежа для постоянных клиентов.

— Индивидуальные условия.

Для дома:

— Любой объем: от мешка до вагона.

— Бесплатный расчет материалов.

Что в канале:

— Акции и скидки

— Закрытие остатков

— Новинки и изменения цен

Есть доставка по РФ.

Консультация по телефону.

👍 Подписывайтесь, чтобы не упустить выгоду!

Получить скидку

#реклама

max.ru

О рекламодателе

Это пошаговый маршрут изучения Linux с упором на практику. Каждый раздел содержит объяснение «почему это устроено именно так», разбор команд и обязательные задания, которые нужно выполнить руками в терминале. Чтение без повторения навыка не даёт — держите терминал открытым рядом с этим текстом.

Как работать с этим курсом: идите сверху вниз, не перепрыгивайте разделы; каждую команду набирайте руками, а не копируйте; в конце каждого блока выполняйте задание; специально ломайте систему в виртуалке и чините — это лучший способ учиться.

https://github.com/justxor/linuxfullroadmap/

@linux_education

Проект расположен на западе Москвы, всего в 3 минутах от метро, рядом с Ульяновским лесопарком и ключевыми магистралями запада Москвы — Боровским, Киевским и Можайским шоссе. До аэропорта Внуково — 10 минут.

В проекте - офисы от 45 до 877 м² с гибкими планировочными решениями, панорамным остеклением и лаконичной архитектурой. На территории кластера — мультиарена, рестораны и кафе, формирующие полноценную среду для работы и встреч.

Стартовые цены - от 13,7 млн ₽

Получите презентацию проекта, актуальные цены и условия покупки, оставив заявку на сайте!

Перейти на сайт

Финансовые услуги оказывает: АО «Альфа-банк». Проектная декларация на сайте https://наш.дом.рф/. Застройщик: ООО "СЗ "РОДИНА ПЕРЕДЕЛКИНО".

#реклама

rodina-peredelkino.ru

О рекламодателе

На открытом уроке разберём, как CISO превращает хаотичный список проблем в понятный план работ с аргументацией для бизнеса и руководства. Поговорим о том, как оценивать реальные риски, отделять критичные угрозы от второстепенных задач и выстраивать приоритеты в условиях ограниченных ресурсов.

Отдельно разберём, как переводить технические проблемы на язык денег, репутации, регуляторных рисков и простоя систем. Покажем, как через риск-реестр, метрики и дорожную карту защищать бюджет на информационную безопасность.

Открытый урок пройдёт 16 июня в 20:00 МСК в преддверии старта курса «Директор по информационной безопасности (CISO)».

Принять участие: https://vk.cc/cYBZ1i

Реклама. ООО «Отус онлайн-образование», ОГРН 1177746618576, www.otus.ru

Оплата криптой.

Бесплатная защита от DDoS-атак.

Тест период 30 дней.

VPS для Wireguard, Xray, Docker

Перейти на сайт

#реклама 16+

ultahost.com

О рекламодателе

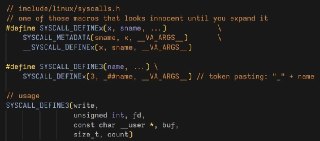

Например:

SYSCALL_DEFINE3(write, unsigned int, fd, const char __user *, buf, size_t, count)

После препроцессора это превращается сразу в несколько функций:

- sys_write

- __se_sys_write

- __do_sys_write

Одна строка описывает системный вызов, а C-препроцессор через макросы и token pasting собирает остальную обвязку автоматически.

Именно поэтому код ядра Linux часто выглядит коротко, пока не начнёшь разворачивать макросы.

@linux_education