Телеграм канал «Код Желтый»

ВК: vk.com/kod_zheltyi

Команда и вакансии в Т: /@t_crew

ИТ-профессии в Т: l.tbank.ru/it_folders

Перечень РКН: l.tbank.ru/knd_tg

телеграм-каналов

рекламных размещений, по приросту подписчиков,

ER, количеству просмотров на пост и другим метрикам

и креативы

а какие хуже, даже если их давно удалили

на канале, а какая зайдет на ура

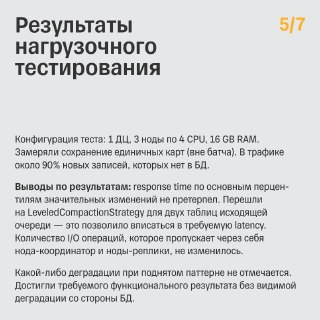

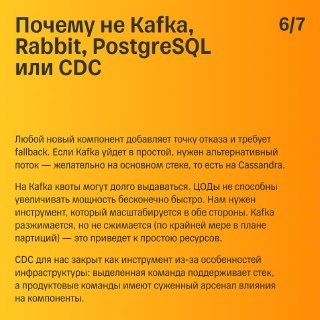

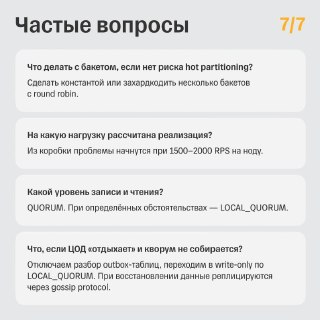

Недавно мы рассказывали, как четыре раза переписывали Outbox на PostgreSQL. Теперь делимся опытом с Cassandra.

Классический Outbox предполагает транзакции, но в Cassandra в привычном понимании их нет. Мы не стали добавлять дополнительные Kafka или RabbitMQ в зоопарк технологий. Вместо этого адаптировали паттерн под свои ограничения и назвали это Non-transactional Outbox.

☺️ ☺️ В карточках наш системный аналитик Илья Глазунов и разработчик Захар Корсаков поделились, как храним события, почему отказались от Exactly Once в пользу At Least Once, зачем нужен часовой лаг между записью и чтением и как воспроизвели логику топиков Kafka внутри Cassandra. Подробнее рассказали на Хабре.

#cassandra #outbox #nosql #eventdriven

Узнаем на кейноуте WWDC26 от Apple уже 8 июня! Соберемся вместе в наших ИТ-хабах, включим трансляцию на большом экране, закажем пиццу и обсудим все самое важное, что можно использовать в работе.

В этом году конференция планируется особенно интересной: с сильным фокусом на Apple Intelligence, большим обновлением Siri, а еще с упором на стабильность и качество в новых iOS и MacOS.

Выбирайте город, в котором хотите посмотреть кейноут WWDC26, и жмите, чтобы зарегистрироваться:

↗️ Москва

↗️ Санкт-Петербург

↗️ Казань

↗️ Нижний Новгород

↗️ Краснодар

↗️ Воронеж

За полтора года наша реализация Outbox прошла четыре итерации. Мы ловили VACUUM, который останавливал сервис на три часа, теряли 5% событий за полтора дня и заваливали поддержку обращениями.

😎 В карточках наш разработчик образовательной платформы Ильдус Тукаев поделился, какие решения они пробовали, с какими трудностями сталкивались и почему остановились на варианте, который сами не считают идеальным. А полная версия с кодом и графиками — на Хабре.

#outbox #postgresql #architecture

Это бесплатный летний фестиваль под открытым небом, где мы заглянем на тысячу лет вперед и разберемся, каким будет будущее.

↗️ Санкт-Петербург, Никольские ряды

📚 4—6 июня

Каждый день будет посвящен отдельной теме: технологиям, бизнесу и человеку будущего. Вас ждут лекции, дискуссии и воркшопы с учеными, визионерами и лидерами индустрий.

Программа почти готова, вот несколько примеров выступлений:

✨ «Мозг как интерфейс: технологии, меняющие человека» — Дмитрий Гадарь и Михаил Лебедев.

✨ «Космос, черные дыры и тайны Вселенной» — Владимир Сурдин.

✨ «Инженеры будущего: кто уже сейчас готовит нас к жизни на Луне» — Янг Мао.

О развлекательной программе тоже не забыли: утром взбодримся спортивными активностями, днем посмотрим на будущее глазами художников на медиаинсталляции «Горизонт событий», а вечером оторвемся на концертах под открытым небом.

Приходите сами и зовите друзей. При регистрации нужно выбрать один день, который вы хотите посетить.

🔖 Посмотрите, какая тема вам ближе, и забирайте билет на сайте.

Мы любим open source. Но на наших масштабах открытые решения часто перестают закрывать все потребности. Поэтому мы их модернизируем, дорабатываем, форкаем или даже переписываем с нуля.

В карточках рассказываем про четыре проекта — от расширения PostgreSQL до собственного Object Storage.

А если хотите узнать, как мы строим новое поколение платформы данных и какие технологии и навыки используют наши инженеры — подписывайтесь на телеграм-канале «Инженеры данных в Т-Банке».

#postgresql #clickhouse #greenplum #s3

А это значит, что скоро стартуют Сезоны кода! В этом году мы отправимся в Санкт-Петербург и Казань, чтобы обсудить разработку и продуктовые практики, отдохнуть от рутинных задач и переключиться на афтепати.

Что будет на фестивалях?

↗️ Доклады в секциях «Клиентоориентированный код», «Backend-методичка» и новой секции «Продуктовая кухня»

↗️ Демозона с продуктами и инженерными решениями

↗️ Интерактивная зона от Т-Образования для начинающих специалистов

↗️ Афтепати с диджей-сетом под открытым небом

↗️ Много веселья и нетворкинга в лаунж-зонах, за играми и в фотозонах

Регистрация в Санкт-Петербург уже доступна, а в Казань откроется совсем скоро.

Выбирайте, какой город вам ближе:

🎨🎨🎨🎨🎨🎨 >> регистрация 🎨

🎨🎨🎨🎨🎨🎨🎨🎨🎨🎨

🎨🎨🎨🎨🎨🎨🎨🎨🎨🎨

🎨🎨🎨🎨🎨🎨🎨🎨🎨🎨

🎨🎨🎨🎨🎨🎨🎨🎨🎨 >> подробнее

🎨🎨🎨🎨🎨🎨🎨🎨🎨🎨

🎨🎨🎨🎨🎨🎨🎨🎨🎨🎨

А теперь переводим наш хайку:

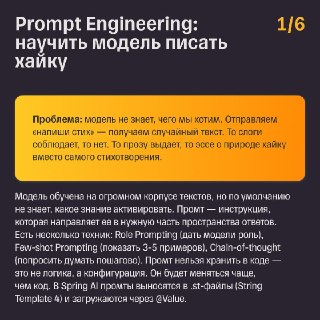

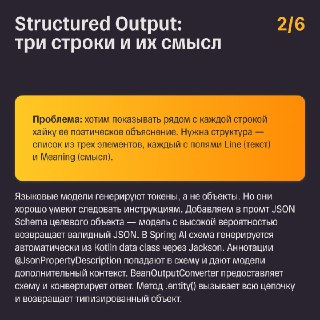

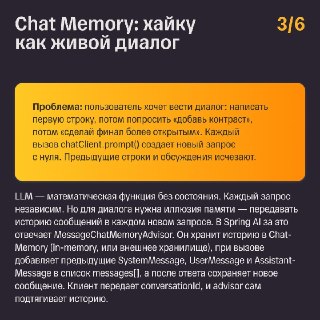

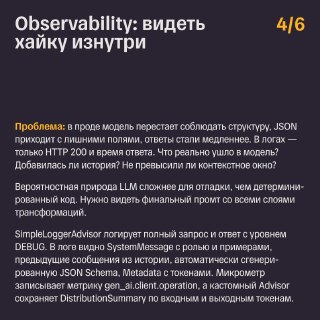

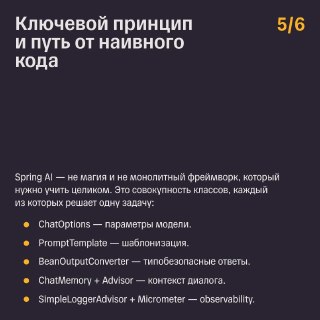

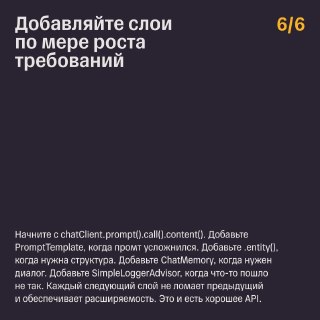

Мы создали сервис для генерации японских стихотворений (хайку), чтобы на практике показать ряд техник GenAI, реализованных в модуле Spring AI. Прошли путь от наивного вызова до production-ready-приложения.

В карточках — разбор четырех проблем и четырех техник:

↗️ Prompt Engineering — научить модель писать в нужном формате.

↗️ Structured Output — получать типизированные объекты вместо строк.

↗️ Chat Memory — сделать диалог, а не набор изолированных запросов.

↗️ Observability — увидеть, что реально уходит в модель.

Больше подробностей и исходный код сервиса-генератора вы найдете в статье на Хабре.

#springai #genai #llm #architecture