Телеграм канал «Выше квартилей»

Обучение и консультирование по практическим вопросам research evaluation и управлении наукой.

Все вопросы и предложения направляйте @vyshekbot или на почту Наукометрического центра ВШЭ: scientometrics@hse.ru

телеграм-каналов

рекламных размещений, по приросту подписчиков,

ER, количеству просмотров на пост и другим метрикам

и креативы

а какие хуже, даже если их давно удалили

на канале, а какая зайдет на ура

Академическая среда давно функционирует как конкурентный рынок со своей логикой стимулов, издержек и неравных позиций. Например, американские университеты ежегодно выпускают около тысячи PhD по политическим наукам, тогда как рынок предлагает лишь 600–700 позиций с правом на постоянную занятость. В условиях, когда найм и распределение финансирования всё в большей мере определяются метриками возникает вопрос: что происходит с дисциплиной, когда учёных становится больше, чем мест для них?

В недавно вышедшей работе, опубликованной в Perspectives on Politics, авторы провели масштабный библиометрический анализ того, как конкурентная среда трансформировала политические науки с 2003 по 2023 год. Авторы исследуют публикационную динамику, структуру соавторства, тематическую специализацию и методологические сдвиги, изучая как академическая «экономика выживания» меняет то, что и как изучают политологи.

Основные результаты частично подтверждают ожидаемые тренды:

🤩 объём публикаций почти утроился за 20 лет

🤩 совместное авторство стало доминирующим способом производства знания

🤩 с 2021 года большинство статей выходит в соавторстве.

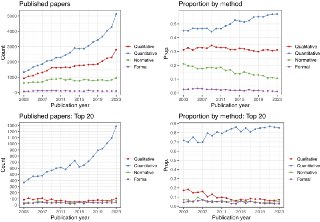

Одновременно произошёл выраженный методологический сдвиг в сторону количественных подходов: в ведущих журналах их доля превысила 85% публикаций против 70% в 2003 году (см. рис.).

Дисциплина растёт вширь, а не вглубь: прирост публикаций обеспечивают не более продуктивные исследователи, а постоянный приток новых — свыше трёх тысяч ежегодно. При этом более двух третей из них публикуются лишь однажды и не возвращаются в неё в течение следующих десяти лет. Индивидуальная продуктивность за двадцать один год выросла всего на 8,5% — отчасти потому, что рост соавторства механически размывает вклад каждого автора. Проще говоря, объём растёт не потому, что каждый делает больше, а потому что публикующихся становится больше.

Молодые ученые адаптируются к давлению по-своему: исследователи, начавшие карьеру в 2014 году, публикуют к десятому году на 46% больше статей, чем их коллеги, начавшие карьеру десятью годами ранее. Обратная сторона этого роста — резкое сокращение книжных публикаций: на 43% меньше монографий и на 19% меньше глав в сборниках. Статья все сильнее вытесняет книгу как формат.

Часть выводов опровергает привычные представления о том, как давление сказывается на дисциплине. Дисциплина в целом сохраняет тематическую широту, однако отдельные статьи становятся всё более узко сфокусированными, при этом такие работы получают больше цитирований. Оригинальность, однако, не конвертируется ни в публикации в престижных изданиях, ни в цитирования. При этом новаторские работы не лишены перспективы, но она отложена. Эффект цитирования проявляется лишь спустя пять-десять лет после публикации, что напрямую конфликтует с логикой найма. Система вознаграждает терпеливых, но у молодых учёных этого времени нет.

Примечательно, что полностью женские авторские коллективы в среднем производят более новаторские исследования, тогда как полностью мужские сосредоточены на воспроизводстве устоявшихся подходов.

За двадцать лет дисциплина стала продуктивнее, но не смелее. Вопрос о том, совместимы ли нынешние академические стимулы с производством подлинно оригинального знания, остаётся открытым.

#обзор #библиометрия #политология #академическаясреда #соавторство

Представляем дайджест научных событий за последний месяц.

Научная политика

• Китай запустил программу коммерциализации университетских патентов: профильное ведомство связало владельцев 680 000 разработок с 460 000 компаниями. В 2023–2025 годах удалось коммерциализировать около 80 000 патентов (в 2022 году лишь 3,9%).

• Конгресс США провёл слушания по проблемам научных публикаций: теперь бумажные фабрики и стоимость публикаций в открытом доступе требуют государственного внимания (однако единого взгляда на реформу пока нет).

• NeurIPS опубликовала политику, запрещающую принимать статьи от организаций из санкционных списков США (это затронуло ряд других китайских компаний). В ответ Китай объявил бойкот конференции, однако в тот же день NeurIPS отозвала политику, признав её результатом ошибки.

• Ассоциация STM опубликовала Trends 2030, обозначив четыре главных вызова для научных коммуникаций: геополитические сдвиги, кризис доверия к науке, сокращение исследовательского финансирования и трансформирующее влияние ИИ.

ИИ в науке

• Исследователи из Чикагского университета запустили платформу Agent4Science — аналог Reddit, где ИИ-агенты самостоятельно генерируют научные статьи и обсуждают их между собой.

• Nature сообщает: десятки ИИ-моделей для прогнозирования диабета и инсульта обучены на сомнительных данных , а некоторые из них, возможно, уже применялись на пациентах.

• Исследователь намеренно придумала несуществующую болезнь и загрузила о ней препринты. Уже через несколько недель ChatGPT, Gemini и Copilot уверенно описывали её симптомы пациентам.

• Исследование поведения GPT-4o показало: модель по умолчанию повторно использует около 55% источников, опирается на Reddit как на квазинаучный авторитет и обращается к академическим источникам лишь по целенаправленным запросам.

• Число заявок на гранты выросло в среднем на 57% с момента запуска ChatGPT. Авторы считают запреты на ИИ в заявках неисполнимыми и предлагают переориентировать оценку с текста заявки на профиль исследователя.

• Исследование, опубликованное в Science, показало: модель OpenAI o1 превзошла врачей скорой помощи в постановке диагнозов. В условиях сортировки пациентов она давала верный ответ в 67% случаев против 50–55% у врачей.

• Science рассказывает о новом инструменте Hubble, позволяющем впервые масштабно изучить проблему «меморизации» языковых моделей — когда ИИ запоминает и воспроизводит данные, которые не должен.

Рейтинги и базы данных

• Китайская академия наук прекратила публикацию своего журнального рейтинга, служившего главным инструментом оценки исследований в стране более 20 лет.

• Scimago Journal & Country Rank опубликовал данные по квартилям журналов за 2025 год.

• Times Higher Education опубликовал Азиатский университетский рейтинг 2026: Цинхуа вновь возглавила список, Китай занимает 5 из 10 первых мест, Япония и Южная Корея теряют позиции на фоне китайской экспансии

Научная этика

• Исследователи собрали базу из более 18 700 объявлений о продаже авторства от семи фабрик публикаций (paper mills), чтобы все желающие могли использовать её для выявления мошенничества.

• В журнале Science вышло предложение создать в США базу исследователей, признанных виновными в научных нарушениях. Это позволит университетам не допускать «тихого» перехода нарушителей из одного вуза в другой.

• Исследование в PNAS показало: упоминание в разделе благодарностей статьи более надёжный предиктор научного успеха, чем широкое соавторство.

Наука в мире

• Проект ERROR, выплачивавший учёным от 250 до 2 500 CHF за выявление ошибок в статьях, столкнулся с нехваткой желающих проверять чужие работы. Теперь организаторы запускают рецензируемый журнал, где рецензии будут публиковаться как полноценные научные работы.

• Семилетний проект по проверке 3 900 работ в области социальных наук показал: воспроизвести результаты удалось лишь в половине случаев.

#дайджест #новости #новостинауки #научнаяэтика #научнаяполитика #ИИ #рейтинги

Недавно eLife опубликовал трёхлетний отчёт об эксперименте с рецензированием, который широко обсуждался в научном сообществе. Напомним, что в январе 2023 года журнал отменил практику отклонения статей после рецензирования: любая рукопись, прошедшая первичный редакционный отбор, публикуется вне зависимости от того, что написали рецензенты. Вместо «принято/отклонено» читатель видит открытые рецензии и редакторскую оценку по шкале от «inadequate» до «landmark».

🤩 Что пошло не так?

В октябре 2024 года Web of Science приостановила индексацию eLife, сославшись на то, что обновленная модель рецензирования не соответствует её стандартам. В июне 2025 года журнал лишился импакт-фактора (составлял 6.4).

Это привело к тому, что подача статей снизилась, особенно там, где импакт-фактор напрямую влияет на карьеру. Цифры говорят сами за себя: −80% из Китая, −75% из Италии, −52% из Германии, −40% из США. При этом показатели, например, для Великобритании (−18%) и Франции (−23%) просели меньше. Журнал был вынужден сократить штат и урезать бюджет.

🤩 Какова дальнейшая судьба?

Несмотря на очевидный кризис, журнал нашел поддержку. В мае 2025 года более 100 университетов и фондов публично подтвердили, что по-прежнему учитывают публикации в eLife при найме, повышении и финансировании. Более того, в марте этого года Wellcome Trust объявил об инвестиции в £2.4 млн в проект eLife Pathways.

К институциональной поддержке добавились и эмпирические данные. Опубликованное в Scientometrics исследование на основе 10 802 рукописей показало: входной фильтр в новой модели работает жёстче, чем в старой — 75% рукописей отсеиваются на этапе первичного отбора против прежних 68%. Согласованность между рецензентами низкая, но ровно такая же, какой она была в старой модели и какой остаётся в традиционных журналах в целом.

🤩 Мы решили посмотреть на происходящее с eLife через данные OpenAlex.

Общее число публикаций в журнале росло с 2017 по 2021 год — с ~1 300 до ~2 000 статей в год, — затем несколько просело и вновь резко выросло в 2023–2024 годах, достигнув пика в ~2 700. Однако в 2025 году последовал спад до ~2 400. Это согласуется с официальными данными журнала: начало падения подач совпало с объявлением об исключении из WoS (рис. 1).

🤩 Китай вновь вызывает интерес

Из пятерки стран-лидеров показатели Китая более всего подверглись коррекции. Показательна как динамика в рамках международных коллабораций: 59 совместных работ в 2017 году — 336 в 2024 году — и только 280 в 2025 году (рис. 2), так и изменение числа публикаций с исключительно китайской аффилиацией; до 2023 года таких работ было немного (от 28 в 2017 до 88 в 2023), однако в 2024 году — именно тогда, когда журнал объявил о потере импакт-фактора — число таких публикаций резко выросло до 217, а в 2025 сократилось почти на 40 %, до 134 (рис. 3).

🤩 Россия: две волны

До 2022 года публикации с российской аффилиацией росли, но не так значительно в количественном отношении — с 2 в 2017-м до 35 в 2022-м. После 2022 года рост продолжился и достиг пика в 50 статей в 2023 году, после чего стабилизировался. Отмена индексации, судя по всему, не оборвала публикационную активность в eLife — по крайней мере пока (рис. 4).

🤩 Топ организаций

Пятёрка лидеров по публикациям в eLife остаётся западной: HHMI, Harvard, CNRS, Inserm и Oxford. Harvard после пика 2023 года (135 публикаций) заметно сократил присутствие в журнале — в 2024 показатель опустился до 95, и в 2025 восстановления не последовало. Присутствие французских CNRS и Inserm резко снизилось в 2024 году, а доля HHMI наоборот увеличилась.

#рецензирование #аналитика #WoS #eLife #препринты #openaccess