Телеграм канал «Дмитрий Никотин»

Группа в ВК - https://vk.com/nikotindmitry

Только по рекламе:

@manager_dnikotin

РКН: https://knd.gov.ru/license?id=672c7991db0c1931b146fbf1®istryType=bloggersPermiss

телеграм-каналов

рекламных размещений, по приросту подписчиков,

ER, количеству просмотров на пост и другим метрикам

и креативы

а какие хуже, даже если их давно удалили

на канале, а какая зайдет на ура

УДАРЫ УКРАИНСКИХ РАКЕТ. ВЗРЫВЫ МАШИН В МОСКВЕ. ПАРАЛЛЕЛИ С ПЕРВОЙ МИРОВОЙ.

📺https://rutube.ru/video/2f86ecf759099937774c83fe084615fd/

❤️Поддержать канал рублем, заранее спасибо - https://pay.cloudtips.ru/p/5c24c9fa

🔥🇷🇺Заказать мои фирменные футболки и свитшоты из выпусков можно тут - https://nikotinshop.ru

➡️Хочешь задать свой вопрос, послушать эксклюзивные аудио выпуски и прогнозы - подпишитесь на мой частный канал.

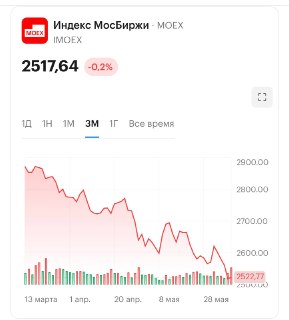

Индекс Мосбиржи снижается четвертый месяц подряд. Локальный годовой максимум был в начале марта — 2912 пунктов, теперь мы вплотную приблизились к уровню поддержки 2500.

Президент РФ Владимир Путин 10 июня проведет совещание с членами правительства, где будут обсуждаться меры по восстановлению инвестиционной активности.

Об этом сообщил журналистам пресс-секретарь главы государства Дмитрий Песков.

🇷🇺Дмитрий Никотин. Подпишись на МАХ канал!

Причина: был связан с "подозреваемыми в принадлежности к террористическим организациям".

Сейчас он с холодной головой и без паники говорит о грядущих потрясениях, которые изменят Россию навсегда. Чтобы предупредить простых людей, он создал свой телеграм-канал об экономике.

Там он простым языком объясняет, к чему нам готовиться летом, что будет с недвижкой и рублём (спойлер: ничего хорошего), какие банки лопнут из-за высокой ставки и куда направить деньги прямо сейчас.

Просто почитайте, что пишет человек, благодаря которому у нас были «сытые нулевые»: @banki_oil

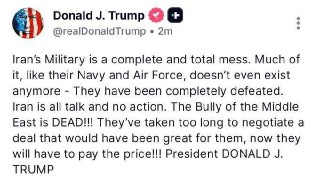

«Вооружённые силы Ирана — полный и абсолютный хаос. Большая их часть, включая ВМФ и ВВС, фактически прекратила существование — они были полностью разгромлены. Иран — это сплошные слова без дел. Хулиган Ближнего Востока МЁРТВ!!! Они слишком долго тянули с переговорами о сделке, которая была бы выгодна для них самих, — теперь им придётся заплатить цену!!! Президент ДОНАЛЬД ДЖ. ТРАМП»

🇷🇺Дмитрий Никотин. Подпишись на МАХ канал!

Все «советское».

Деточка, даже не знает, что уничтоженное пано обороны Севастополя это про Крымскую войну, которая была в XIX веке.

Хотя про это даже написано было в посте.

🇷🇺Дмитрий Никотин. Подпишись на МАХ канал!

Глава МИД РФ указал на то, что Ереван активно наращивает сотрудничество с НАТО.

🇷🇺Дмитрий Никотин. Подпишись на МАХ канал!