Телеграм канал «Empatia — well-being платформа»

https://empatia.kz и https://empatia.uz

телеграм-каналов

рекламных размещений, по приросту подписчиков,

ER, количеству просмотров на пост и другим метрикам

и креативы

а какие хуже, даже если их давно удалили

на канале, а какая зайдет на ура

Сегодня программы wellbeing есть у многих компаний. Однако немногие организации выстраивают их как полноценную часть бизнес-стратегии.

Один из наиболее известных примеров — Unilever.

Компания разработала комплексную модель благополучия сотрудников, которая включает четыре взаимосвязанных направления:

✅ физическое здоровье;

✅ психическое здоровье;

✅ эмоциональное благополучие;

✅ ощущение смысла и цели в работе.

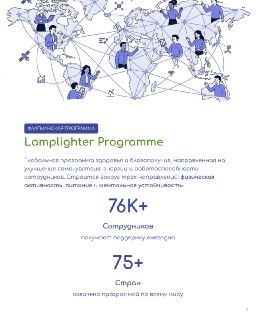

Для реализации стратегии была создана глобальная программа Lamplighter. Она направлена на раннее выявление факторов риска для здоровья сотрудников, развитие полезных привычек, поддержку физической активности, питания, сна и психологической устойчивости. Программа действует по всему миру и охватывает десятки тысяч сотрудников ежегодно.

Отдельное внимание компания уделяет профилактике выгорания и стрессов. Исследование, проведенное среди сотрудников Unilever, показало, что программа осознанности и управления стрессом способствовала значительному снижению уровня стресса и риска длительного отсутствия на работе, а положительный эффект сохранялся даже спустя шесть месяцев после завершения программы.

Опыт Unilever показывает, что инвестиции в благополучие сотрудников могут рассматриваться не как расходы, а как часть стратегии устойчивого развития, управления человеческим капиталом и повышения организационной эффективности.

Недавно, 1 июня, во многих странах отмечали День защиты детей, и это хороший повод вспомнить, что забота о детях начинается не только с внешней безопасности, образования и развития, но и с понимания их внутреннего мира.

Детство не заканчивается в тот момент, когда мы взрослеем. Оно продолжает жить в наших реакциях, страхах, способах общения, ожиданиях от отношений и представлениях о себе.

Психологи часто отмечают, что многие наши эмоциональные сценарии формируются именно в ранние годы. Поэтому понимание своего детского опыта помогает бережнее относиться к себе, осознаннее выстраивать отношения и лучше понимать не только себя, но и своих детей.

Собрали 5 книг, которые помогают по-новому взглянуть на детство, привязанность, семейные сценарии и эмоциональное взросление.

1. Тайная опора

Людмила Петрановская — известный психолог, специалист по вопросам привязанности и семейных отношений. В книге простым языком объясняется, как у ребенка формируется чувство безопасности и почему надежная эмоциональная связь со взрослым влияет на всю дальнейшую жизнь.

2. Что с тобой случилось?

Авторы предлагают смотреть на поведение человека через призму его жизненного опыта. Особое внимание уделяется тому, как детские переживания влияют на стресс, эмоциональные реакции, самооценку и способность строить близкие отношения во взрослом возрасте.

3. Токсичные родители

Сьюзан Форвард подробно рассматривает разные формы эмоционального давления, контроля, критики и манипуляций в семье. Эта книга помогает лучше понять происхождение внутренних конфликтов и увидеть, где важно выстраивать личные границы.

4. Драма одаренного ребенка

Классическая работа о том, как стремление заслужить любовь и одобрение взрослых может приводить к подавлению собственных чувств и потребностей. Книга помогает задуматься о том, где мы продолжаем жить ради ожиданий других, забывая о себе.

5. Взрослые дети эмоционально незрелых родителей

Практическая книга для тех, кто хочет понять, как семейная среда влияет на эмоциональную зрелость, отношения и ощущение собственной ценности. Автор показывает, как распознавать незрелые модели общения и постепенно возвращать себе внутреннюю опору.

📖 Каждая из этих книг напоминает, что детство — это важный этап формирования личности. Чем лучше мы понимаем этот опыт, тем больше у нас возможностей заботиться о себе, своих близких и будущих поколениях бережнее и осознаннее.

AI все активнее входит в рабочие процессы. Он помогает автоматизировать рутинные задачи, ускорять аналитику, готовить документы, структурировать информацию и повышать эффективность команд.

Но у этой трансформации есть и другая сторона.

Если AI внедряется без понятных правил и внимания к человеческому опыту, он может не снижать нагрузку, а усиливать ее. Сотрудник начинает быстрее выполнять задачи, но при этом больше проверяет, редактирует, сравнивает, принимает решения и удерживает в голове ещё больше информации.

В результате появляется новый слой цифровой усталости.

Раньше мы чаще говорили о перегрузке от чатов, уведомлений, почты и постоянной подключенности. Сейчас к этому добавляется AI-нагрузка: необходимость быстро адаптироваться, осваивать новые инструменты, оценивать качество AI-ответов и сохранять ответственность за итоговый результат.

Для компаний это важный сигнал.

Внедрение AI должно сопровождаться не только обучением инструментам, но и правилами здорового использования:

— где AI помогает, а где создает лишнее давление;

— какие задачи действительно стоит автоматизировать;

— как сохранять фокус и качество решений;

— как не превращать скорость в постоянное ожидание мгновенного результата;

— как поддерживать сотрудников в период технологических изменений.

Мы верим, что технологии должны усиливать человека, а не перегружать его.

Wellbeing будущего будет учитывать не только физическое и эмоциональное состояние сотрудников, но и их цифровую, информационную и AI-нагрузку.

В исследовании ANCOR «Соцпакет 2026: что предлагают компании своим сотрудникам» представлены результаты опроса 60 компаний. По данным исследования, в Казахстане 46% компаний рассматривают соцпакет как инструмент привлечения сотрудников, 39% — как инструмент удержания, а 45% — как стандарт. При этом 48% компаний регулярно анализируют использование льгот сотрудниками.

Самые распространенные льготы сегодня:

— медицинское страхование;

— компенсация сотовой связи;

— материальная помощь в трудных ситуациях;

— обучение и оплата обучения;

— страхование жизни;

— дополнительные выходные;

— медицинское страхование членов семьи;

— компенсация питания;

— компенсация проезда;

— поддержка занятий спортом.

Интересно, что среди наиболее востребованных льгот сотрудники чаще всего выделяют медицинское страхование, материальную помощь, компенсацию спорта, дополнительные выходные и обучение.

А среди льгот, которые сотрудники просят добавить, на первом месте — компенсация занятий спортом, затем дополнительные выходные, обучение, медицинское страхование членов семьи и питание.

Это свидетельствует о важном сдвиге, что соцпакет становится все больше связан с wellbeing, восстановлением, здоровьем, семьей, развитием и качеством жизни.

Будущее корпоративной поддержки — за более гибким и человекоцентричным подходом. Сильный соцпакет должен учитывать не только должность сотрудника, но и его реальный жизненный контекст✅.

HR-кейсы, о которых будут говорить весь следующий год 👀

4 июня 2026 года в Rixos Almaty состоится кейс-конференция HUMANRISE 2026 — профессиональная площадка для HR-лидеров Центральной Азии и Кавказа.

HUMANRISE объединяет компании, которые не просто обсуждают тренды, а показывают реальные HR-решения, работающие внутри бизнеса.

В программе:

• 25+ кейсов компаний в 6 номинациях

• реальные практики employer brand, talent management, AI & digital HR

• выступления HRD, CEO и международных экспертов

• панельные дискуссии о будущем HR

• сильный профессиональный нетворкинг

Это возможность:

— увидеть, какие HR-проекты сегодня действительно дают результат

— перенять инструменты и подходы крупных компаний

— познакомиться с HR-лидерами рынка

— получить идеи, которые можно внедрять в своей компании уже завтра

📍4 июня 2026

📍Rixos Almaty

Стоимость участия: 139 200 ₸ (с НДС)

Для приобретения билета оставляйте заявку на Hello@humanrise.kz или покупайте на showmarket.

Количество мест ограничено.

Сегодня wellbeing всё чаще воспринимается не как отдельная HR-активность, а как практический инструмент поддержки сотрудников и снижения ежедневного напряжения в рабочей среде.

На стенде EMPATIA💙 мы знакомили гостей с платформой, которая помогает компаниям выстраивать более системную заботу о людях.

Психологическая поддержка, финансовые консультации, вопросы семьи и отношений, юридическая помощь, lifestyle-направления и даже зоопсихология — всё это может быть частью современной корпоративной среды.

Почему это важно?

У сотрудников бывают разные жизненные ситуации: стресс, финансовые вопросы, семейные сложности, юридические вопросы, эмоциональная усталость, потребность в консультации или поддержке. И не всегда эти ситуации остаются за пределами работы.

В такие моменты человеку нужна не общая рекомендация, а понятный, конфиденциальный и доступный путь к помощи.

Наш подход простой: меньше трения в ежедневной работе, больше опоры у людей.

Когда поддержка становится ближе и понятнее, wellbeing становится реальным инструментом для устойчивости команды, сохранения энергии и формирования более здоровой рабочей культуры.

Этот день напоминает о базовой ответственности общества — создавать для детей безопасную, поддерживающую и развивающую среду.

Когда мы говорим о благополучии ребенка, важно смотреть шире, чем только на физическую безопасность, образование и доступ к медицинской помощи. Не менее значимы эмоциональная безопасность, доверие, стабильность, уважительное общение и возможность быть услышанным.

Ребенку важно знать, что рядом есть взрослые, к которым можно обратиться. Что его чувства имеют значение. Что ошибки не лишают его поддержки. Что усталость, тревога, страх или растерянность могут быть замечены и приняты.

При этом детский wellbeing напрямую связано с состоянием взрослых.

Родители, педагоги, наставники и специалисты, работающие с детьми, тоже нуждаются в поддержке. Эмоционально истощенному взрослому сложнее сохранять спокойствие, быть внимательным и устойчивым. Поэтому забота о детях включает заботу о семьях, школах, рабочих коллективах и социальных системах вокруг ребёнка.

Для компаний эта тема тоже важна. Поддержка сотрудников-родителей, гибкость, уважение к семейной нагрузке и культура заботы помогают взрослым быть более устойчивыми дома и на работе.

Wellbeing начинается с человеческого отношения: с безопасности, уважения, поддержки и права быть услышанным.

Пусть каждый ребенок растет в среде, где есть любовь, спокойствие, забота и вера в его будущее.